Einführung in das Hardware-Setup für AI-Training

Das Training grosser KI-Modelle wie Large Language Models (LLMs) und Diffusionsmodelle erfordert eine leistungsstarke Hardware, besonders wenn das Training offline und lokal stattfinden soll. Solche Modelle benötigen enorme Rechenleistung und Speicherressourcen, um effizient trainiert zu werden. In diesem Beitrag zeigen wir dir drei mögliche Konfigurationen, die von einem günstigen bis hin zu einem extrem teuren Setup reichen. Diese Konfigurationen helfen dir, die optimale Hardwarelösung für deine Bedürfnisse zu finden, sei es für ein begrenztes Budget oder ein High-End-Setup.

Günstige Konfiguration

Für Einsteiger oder solche mit einem limitierten Budget gibt es Hardware-Optionen, die zwar nicht auf dem höchsten Level operieren, aber dennoch in der Lage sind, mittelgrosse Modelle wie kleinere LLMs oder Diffusionsmodelle zu trainieren.

- Prozessor (CPU): AMD Ryzen 9 5950X – Ein leistungsstarker 16-Kern-Prozessor, der auch bei parallelen Aufgaben und hohen Lasten eine gute Leistung erbringt.

- Grafikkarte (GPU): NVIDIA RTX 3060 – Diese Grafikkarte bietet 12 GB VRAM und ist eine erschwingliche Wahl für das Training kleinerer Modelle.

- Arbeitsspeicher (RAM): 64 GB DDR4 – Ein solides Minimum, um grosse Datensätze zu laden und gleichzeitig das System stabil zu halten.

- Speicher (ssD): 2 TB NVMe ssD – Schneller Speicher ist entscheidend, um Daten effizient zu lesen und zu schreiben, besonders bei grossen Modellparametern.

- Netzteil: 750W Netzteil – Um die Hardware stabil zu betreiben, ist ein ausreichend starkes Netzteil notwendig.

Diese Konfiguration bietet ein gutes Preis-Leistungs-Verhältnis und kann kleinere AI-Modelle wie GPT-2 oder begrenzte Diffusionsmodelle bewältigen. Für Nutzer, die erst in das KI-Training einsteigen, ist dies eine brauchbare und erschwingliche Option.

Teure Konfiguration

Wer mehr Leistung für grössere Modelle wie GPT-3 oder detaillierte Diffusionsmodelle benötigt, sollte in leistungsfähigere Hardware investieren. Diese Konfiguration ermöglicht es, auch anspruchsvollere Modelle zu trainieren, ohne auf Cloud-Services zurückgreifen zu müssen.

- Prozessor (CPU): Intel Core i9-13900K – Ein High-End-Prozessor mit 24 Kernen, ideal für Aufgaben, die starke Parallelisierung und Rechenleistung erfordern.

- Grafikkarte (GPU): NVIDIA RTX 4090 – Mit 24 GB VRAM ist diese GPU für die meisten KI-Aufgaben mehr als ausreichend und beschleunigt das Training erheblich.

- Arbeitsspeicher (RAM): 128 GB DDR5 – Ausreichend RAM, um grosse Modelle und Datensätze im Arbeitsspeicher zu behalten, was das Training beschleunigt.

- Speicher (ssD): 4 TB NVMe ssD – Grosse Modelle und Trainingsdaten erfordern viel Speicherplatz. Eine schnelle NVMe ssD sorgt für kurze Ladezeiten.

- Netzteil: 1000W Netzteil – Die Leistungsaufnahme dieser Hardware erfordert ein besonders starkes Netzteil.

Diese Konfiguration bietet genug Leistung, um mittlere bis grosse Modelle effizient offline zu trainieren. Nutzer, die regelmässig mit grossen Datensätzen und komplexen Modellen arbeiten, finden hier ein ausgewogenes Setup.

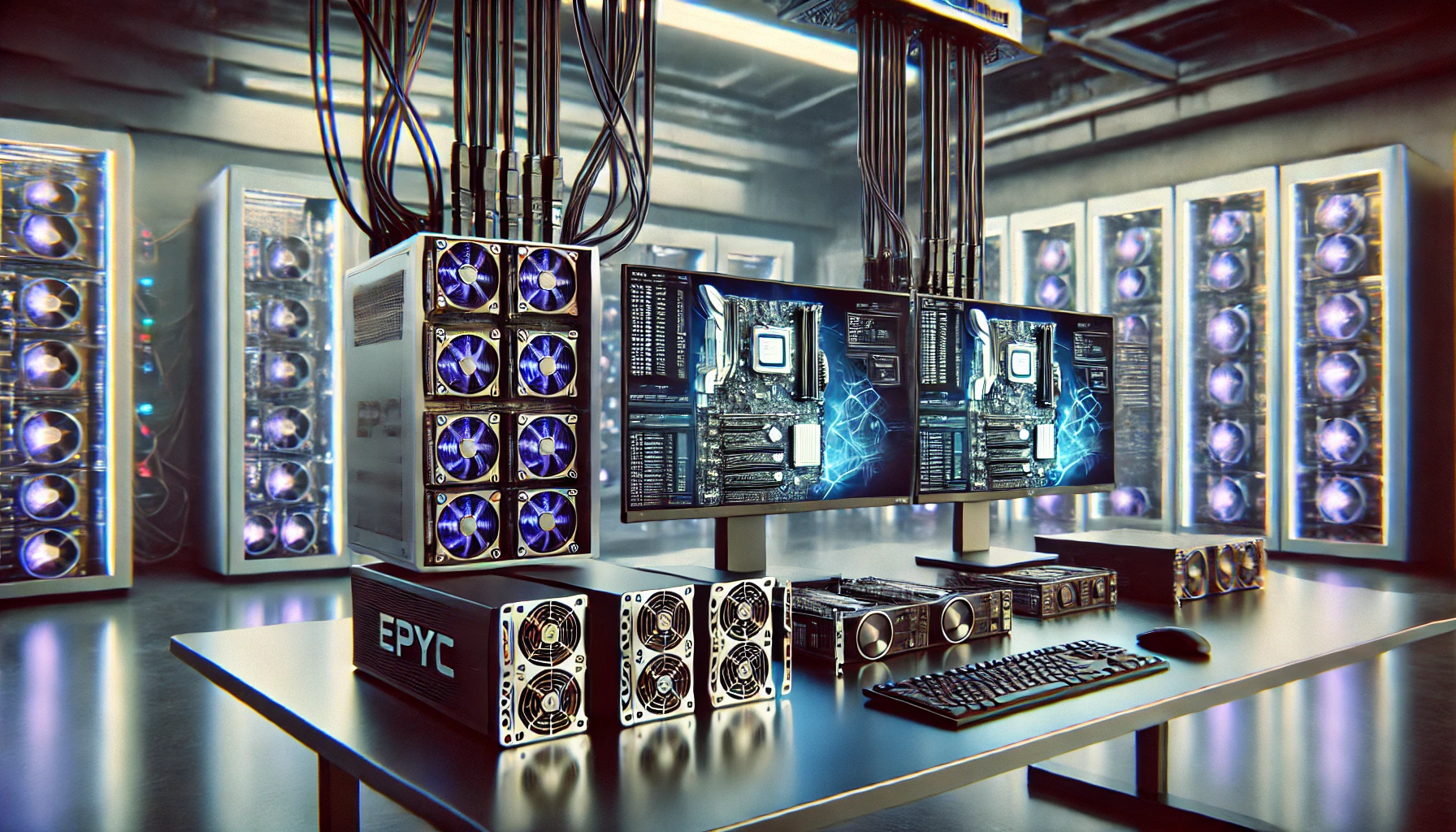

Extrem teure Konfiguration

Für diejenigen, die das Beste vom Besten wollen und mit den grössten LLMs oder Diffusionsmodellen arbeiten möchten, die es gibt, erfordert das Training eine Hardware auf einem extrem hohen Niveau. Diese Konfiguration richtet sich an professionelle Forschungs- und Unternehmensanwendungen.

- Prozessor (CPU): AMD EPYC 7742 – Ein Server-Grade-Prozessor mit 64 Kernen und Hyper-Threading, der selbst die intensivsten Rechenlasten bewältigt.

- Grafikkarte (GPU): NVIDIA A100 Tensor Core – Diese professionelle GPU mit 80 GB HBM2e-Speicher ist speziell für das Training von AI-Modellen optimiert.

- Arbeitsspeicher (RAM): 1 TB DDR5 – Grosse LLMs wie GPT-4 erfordern eine enorme Menge an Arbeitsspeicher, um effizient geladen und trainiert zu werden.

- Speicher (ssD): 8 TB NVMe ssD – Grosse Datenmengen und Modelle benötigen viel Platz und schnellen Zugriff. Eine NVMe ssD dieser Grösse und Geschwindigkeit ist hier unverzichtbar.

- Netzteil: 2000W Netzteil – Die Leistungsaufnahme in dieser Konfiguration ist massiv und benötigt ein entsprechendes Netzteil.

Diese Konfiguration ist für Institutionen oder Unternehmen, die in der Lage sein wollen, die grössten und komplexesten Modelle wie GPT-4 oder massive Diffusionsmodelle lokal zu trainieren. Diese Hardware bietet das Maximum an Performance und ist auf Skalierbarkeit ausgelegt.

Das Training grosser KI-Modelle wie LLMs oder Diffusionsmodelle erfordert gut durchdachte Hardware-Setups. Während für Einsteiger ein günstiges Setup bereits ausreicht, werden Profis und Unternehmen auf leistungsfähigere Konfigurationen zurückgreifen wollen. Diese drei Varianten – von günstig bis extrem teuer – zeigen die verschiedenen Optionen, die es für das lokale und offline Training von AI-Modellen gibt.